一文で言うと: GPT は突然現れたものではありません。深層学習、スケール、そして Transformer アーキテクチャという10年分の積み重ねの結果です。

1.1 やわらかい出発点

この章はあえて軽めにしてあります。数式もコードも出てきません。答えたい問いはひとつだけです。

GPT はどこから来たのか?

多くの人が初めて ChatGPT を触ったとき、技術が空から降ってきたように感じたと思います。でも、その背後にある Transformer アーキテクチャは、製品として世に出る何年も前から地道に積み上がってきたものです。

歴史を知っておくと、次のことがやりやすくなります。

- 直感を養う: なぜ Transformer は言語モデリングにおいて RNN や LSTM を置き換えたのか?

- 登場人物を理解する: なぜ OpenAI、Google、Meta、その他の研究所がそれぞれ異なる意味で重要なのか?

- トレンドラインを読む: チャットモデルから、エージェント、ディープリサーチ、世界モデルへとどうつながっていったのか?

1.2 2015年: 2つの種子

2015年に起きた2つの出来事が、その後の AI 風景の多くを形作りました。

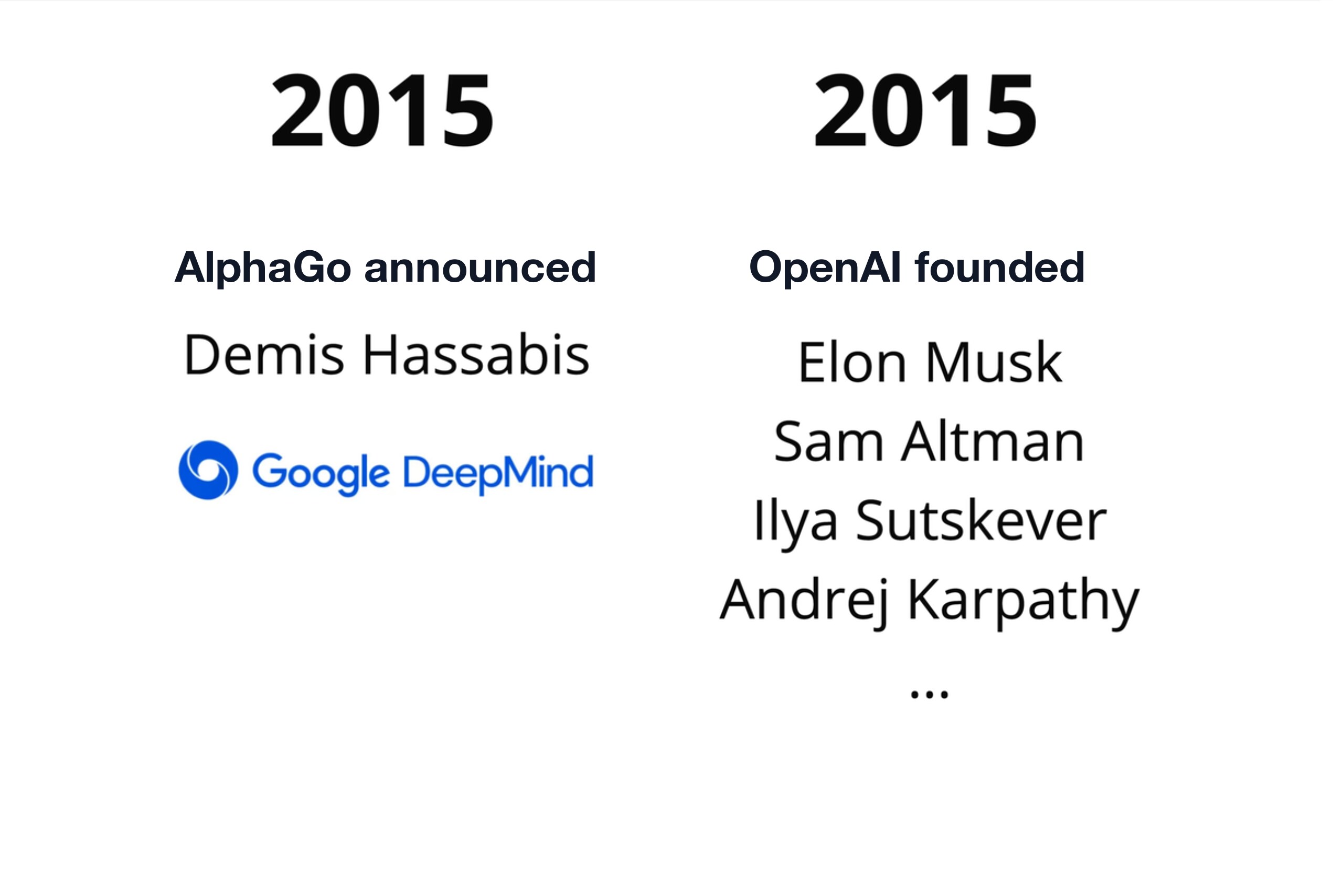

1.2.1 AlphaGo

ひとつめは AlphaGo です。

Demis Hassabis が率い、Google 傘下にあった DeepMind が、トップ棋士を破るシステムを作りました。囲碁はチェスよりもはるかに難しいとされていました。探索空間が膨大で、状態空間の複雑度はおよそ 10^170。観測可能な宇宙の原子の数より多い局面数です。AI が囲碁を攻略するにはあと10年はかかると、多くの人が思っていました。AlphaGo は、深層学習と強化学習の組み合わせが「まだ遠い」とされていた問題を解けることを示しました。

ここから得られる教訓はシンプルです。

深層学習 × スケール は、能力の驚くようなジャンプを生み出す。

1.2.2 OpenAI

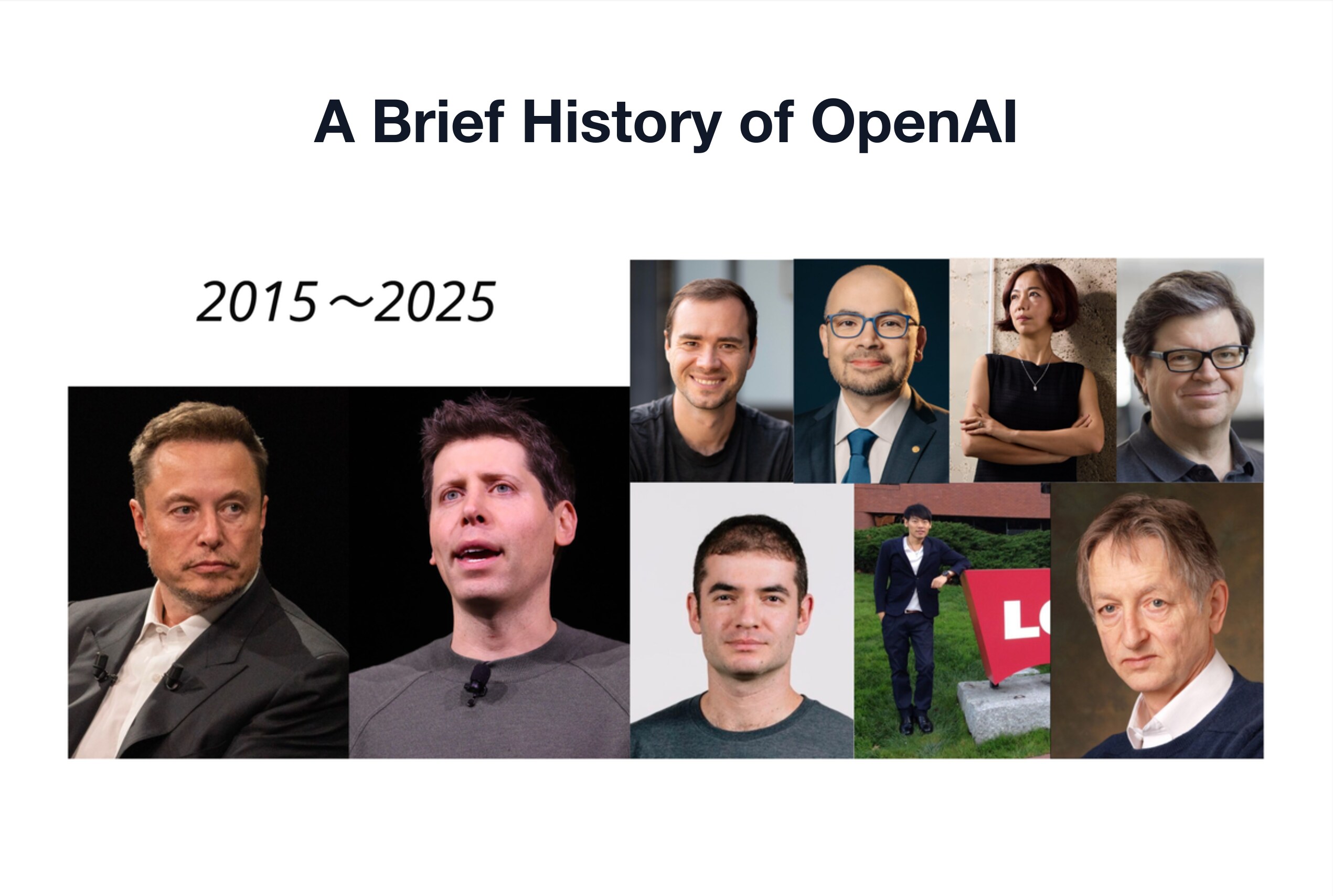

ふたつめが OpenAI の設立です。

最初のアイデアは「AI は重要すぎるので、一社に独占させてはいけない」というものでした。創設メンバーには Elon Musk、Sam Altman、Ilya Sutskever、Greg Brockman、Wojciech Zaremba、Andrej Karpathy などが名を連ねます。

OpenAI は非営利の研究所として、「強力な AI を作りつつ、その恩恵を広く共有する」という野心的なミッションを掲げてスタートしました。

このミッションは、後に現実的な問題と衝突することになります。フロンティアの AI には、莫大な計算資源、データ、人材が必要なのです。

1.3 主要人物

時系列を進める前に、いくつかの名前を押さえておきましょう。分野自体は広大ですが、初期の LLM のストーリーは、意外なほど狭い研究者・教師・創業者・エンジニアのネットワークによって形作られています。

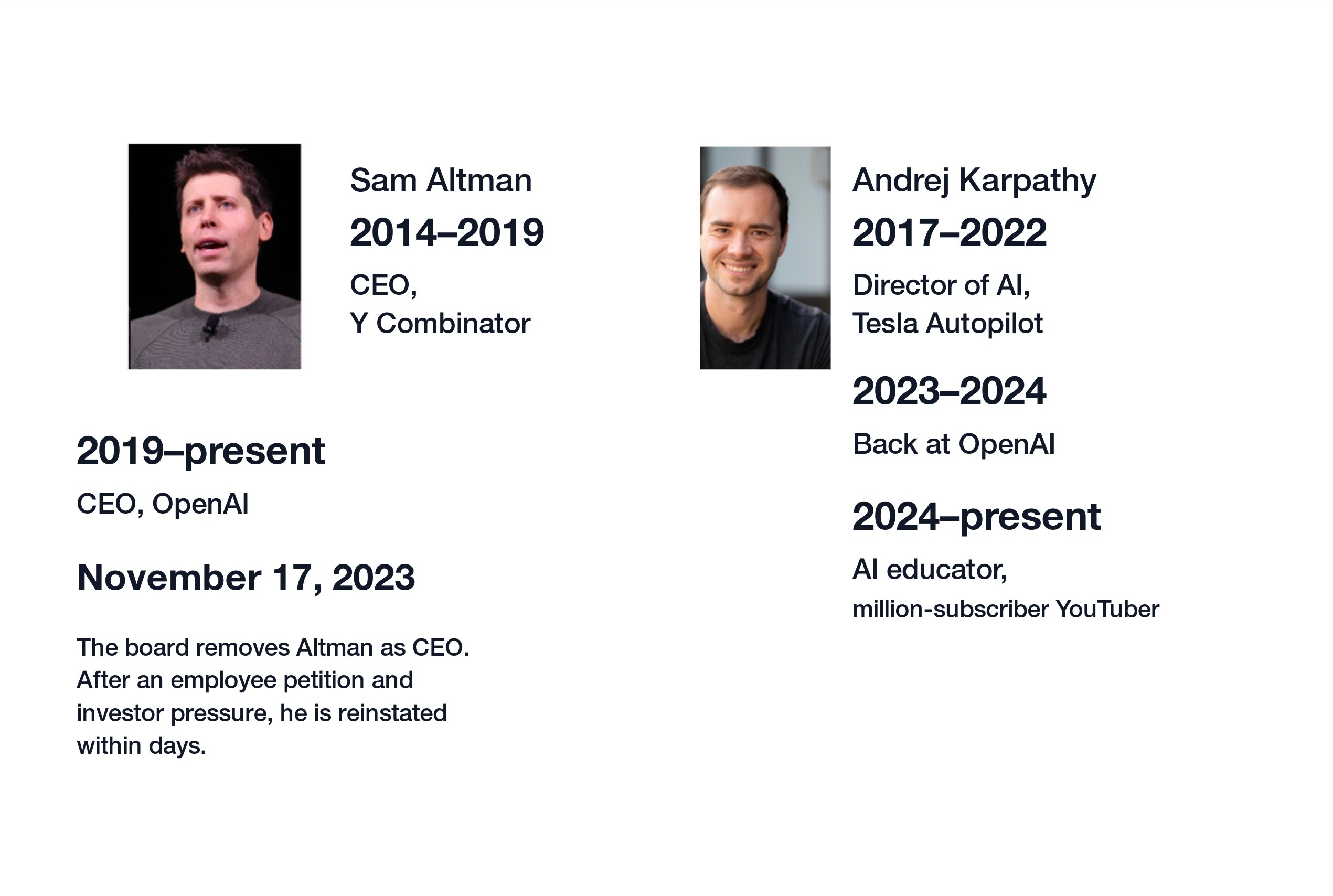

1.3.1 Sam Altman

Sam Altman は2014年から2019年まで Y Combinator を率いていました。彼は深層学習の研究者として知られているわけではありません。彼の強みは組織面にあります。人を集め、資本を配分し、研究の方向性を製品の方向性に変換する力です。

これは重要でした。なぜなら、大規模モデルの学習は、論文を書く問題というより、インフラとビジネスの問題に急速になっていったからです。

1.3.2 Ilya Sutskever

Ilya Sutskever は OpenAI の中核を担う深層学習研究者のひとりです。Geoffrey Hinton のもとで学び、本格的なニューラルネットワーク研究を GPT 系モデルの土台に持ち込んだ人物です。

決定的な選択のひとつが、「Transformer アーキテクチャを言語モデリングに大規模適用する」というものでした。

1.3.3 Andrej Karpathy

Andrej Karpathy は、ビルダーとして、そして教師として、ひときわ重要な存在です。2017年から2022年まで Tesla の AI ディレクターを務め、自動運転のビジョンシステムを担当しました。それ以前には、Stanford の CS231n という講義を通じて、現代的なコンピュータビジョンと深層学習を「神秘」ではなく「学べるもの」にしてくれました。

彼の講義、コード、そして「大規模言語モデルは2つのファイルにすぎない」という有名なフレーミング(これは第2章で扱います)は、LLM をいちばん明快に解きほぐしてくれる素材です。

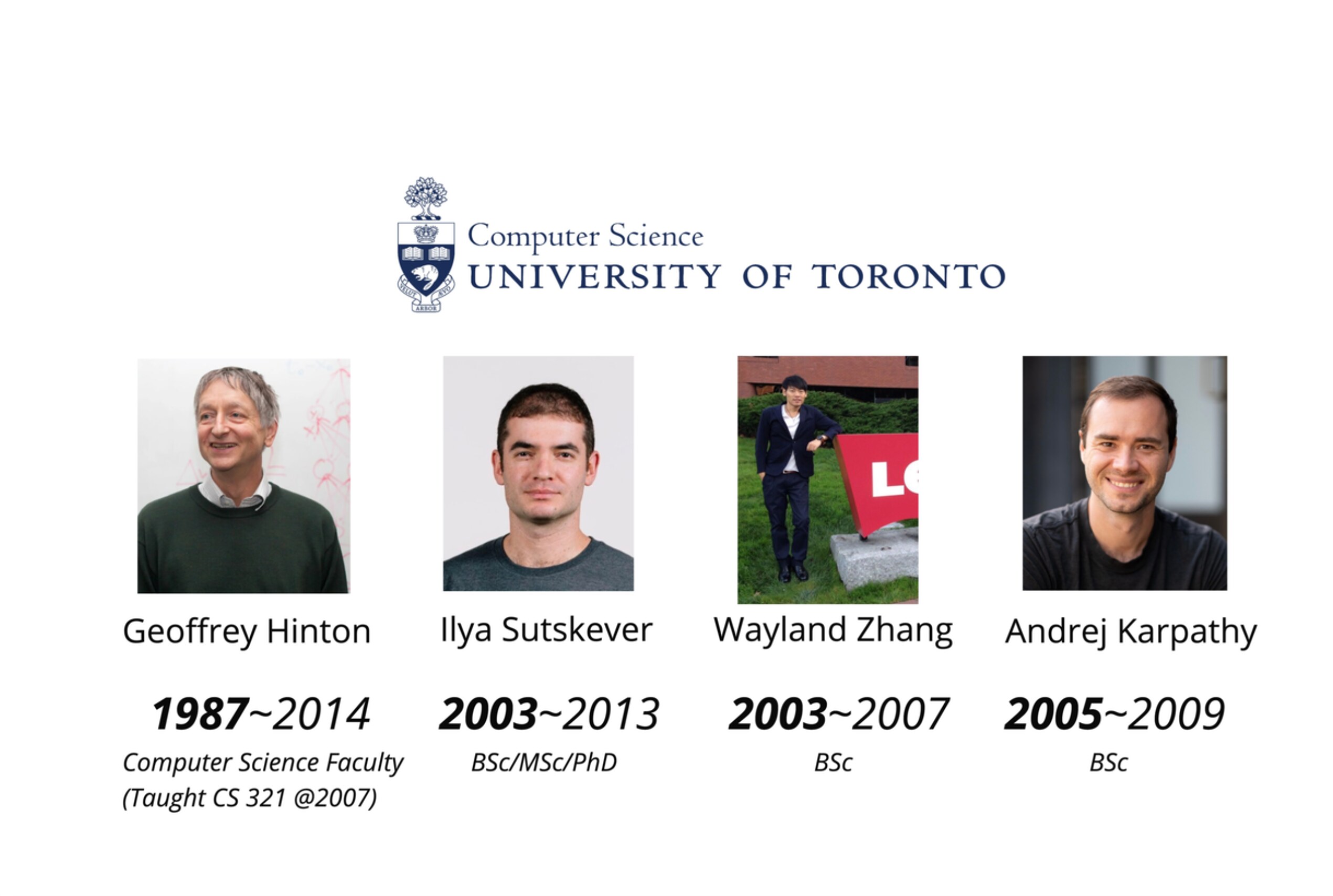

1.3.4 トロントのつながり

トロント大学は、深層学習が再興した中心地のひとつです。

- Geoffrey Hinton が現代の深層学習の基礎を築きました。

- Ilya Sutskever は Hinton のもとで学びました。

- 著者である Wayland Zhang も同時期にトロント大学でコンピュータサイエンスを学び、その後、起業の道へと進みました。

- Andrej Karpathy は2005年から2009年までトロント大学で学部時代を過ごし、その後 Stanford に進みました。

これは「ある一校が分野を独占している」という話ではありません。アイデアは人を介して伝わる、ということを思い出させてくれる話です。小さな研究の系譜が、Google、OpenAI、Tesla、Meta、そしてオープンソースコミュニティ全体に影響を及ぼせるのです。

1.4 2017年: Transformer 登場

2017年は、本書のなかで最も重要な年です。

1.4.1 地図を書き換えた論文

2017年、Google の研究チームが 「Attention Is All You Need」 を発表しました。

この論文が導入したのが Transformer アーキテクチャです。中心的な主張は大胆でした。

再帰(リカレンス)はいらない。畳み込みもいらない。系列モデリングは Attention だけで担える。

当時、自然言語処理の標準ツールは RNN と LSTM でした。Transformer はトークンを並列で処理し、Attention を使って位置同士を直接つなぐという、当時としては奇妙な見た目をしていました。

しかし、この特徴こそが大規模学習に必要なものでした。

- 並列計算: 系列全体を効率よく処理できる。

- 長距離の関係: Attention が、系列の遠い位置にあるトークン同士を直接つなげる。

- スケーラビリティ: アーキテクチャが GPU や TPU の行列演算にきれいに対応する。

1.4.2 GPT は「生成のための Transformer」

2018年、OpenAI は GPT-1 によって、Transformer アーキテクチャが言語生成にも使えることを示しました。

GPT は次の頭文字です。

- Generative: 新しいテキストを生成できる。

- Pre-trained: 大規模なテキストからまず学習する。

- Transformer: その仕事を担うアーキテクチャ。

機械翻訳のためのアーキテクチャが、汎用的な言語モデルのアーキテクチャへと姿を変え始めた瞬間です。

1.5 2018年: OpenAI の形が変わる

ちょうど同じ時期、OpenAI 自体も変わりました。

1.5.1 研究の理想から、計算資源の現実へ

大規模モデルは高くつきます。GPU、データ基盤、分散学習、そしてハードウェアとソフトウェアをまたいで障害を切り分けられるチームが必要です。

そうなると、純粋な非営利という形では立ち行かなくなってきます。OpenAI はフロンティアで競うために必要な資金を調達できるよう、利益上限つきの営利モデル(capped-profit)へと移行しました。

この動きは今も議論を呼びますが、根っこにある圧力は理解しやすいものです。言語モデルのスケーリングは資本集約的なのです。

1.5.2 Elon Musk が取締役を退く

2018年、Elon Musk は OpenAI の取締役会から離れました。表向きの説明は、Tesla 自身の AI 開発との利益相反の可能性。ですが、ゴシップよりも長く効いてくる教訓があります。AI が戦略的になった瞬間から、ミッション・統治・資本・競争の問題はもう切り離して扱えなくなった、ということです。

1.5.3 統治をめぐる緊張

AI 研究所はモデルだけを作っているわけではありません。リリース、安全性、商用化、コントロールに関する意思決定もしています。ミッションと資本のあいだの緊張は消えません。それも物語の一部になっていきました。

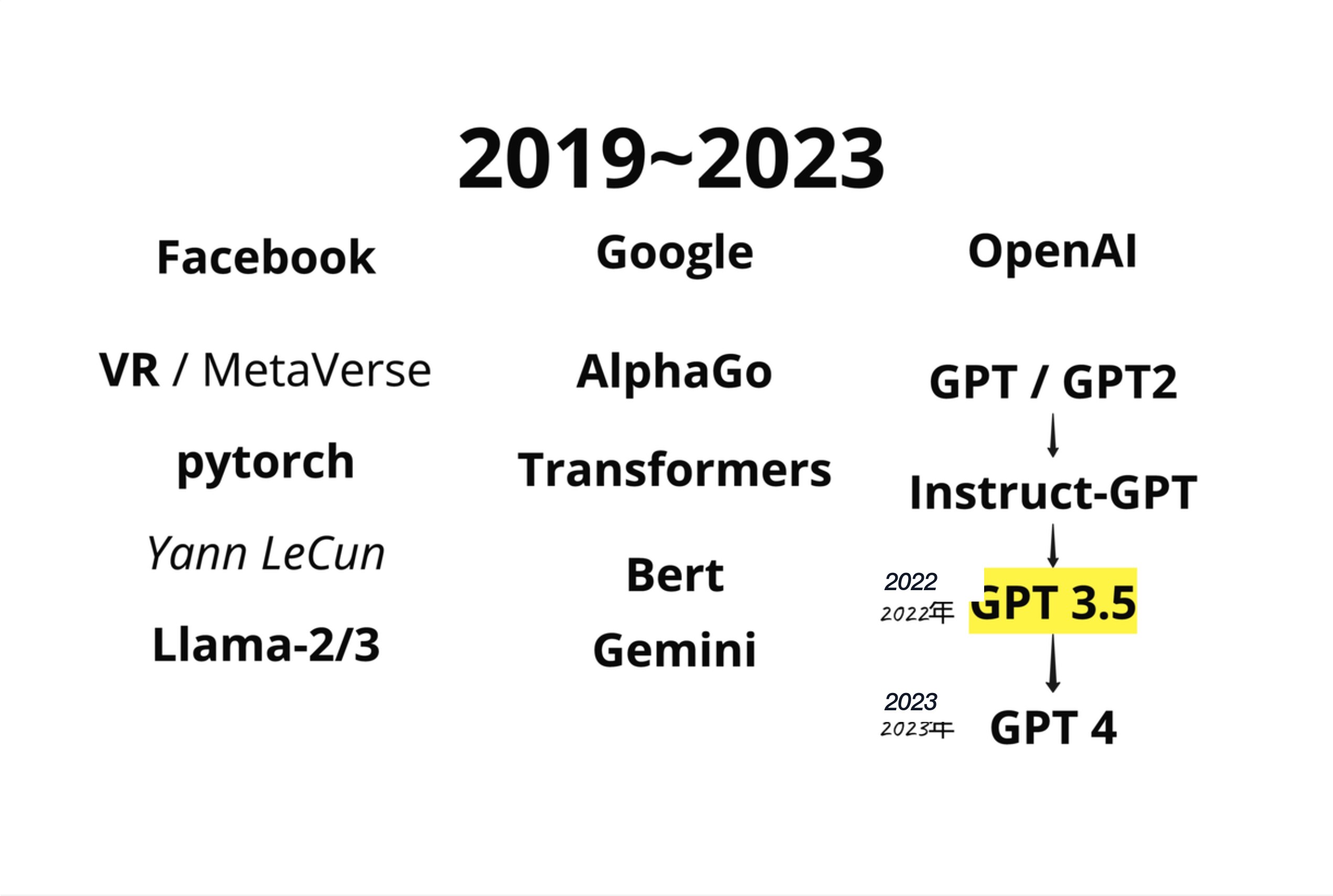

1.6 2019〜2023年: 大規模モデル競争

2019年から2023年にかけて、言語モデルは研究デモから、何百万人もの人が使う製品へと移っていきました。

1.6.1 大きく3つの陣営

2023年までに、分野には見分けやすい陣営がいくつか現れました。

| 組織 | 代表的な仕事 | 性格 |

|---|---|---|

| OpenAI | GPT-2、GPT-3、ChatGPT、GPT-4 | クローズドな製品、コンシューマ向け最大のブレイクスルー |

| BERT、Transformer の研究、Gemini | 厚い研究基盤、製品化はやや遅め | |

| Meta | PyTorch、LLaMA | オープンモデルとツールチェーンのエコシステム |

この表は単純化したものですが、便利です。同じアーキテクチャを、各組織が異なる経路 ― クローズドな製品、研究プラットフォーム、オープンウェイト、ツール群 ― で押し進めたわけです。

1.6.2 GPT 系の進化

GPT 系はおおよそ次のように進化しました。

- GPT-1, 2018年: Transformer が言語モデルとして機能することを示した。

- GPT-2, 2019年: スケールアップして、生成品質で人々を驚かせた。

- GPT-3, 2020年: 1750億パラメータと、強力な few-shot 振る舞い。

- InstructGPT, 2022年: 人間のフィードバックを使って出力をより役立つものにした。

- ChatGPT, 2022年11月: LLM を一般の人たちが触れるものにした。

- GPT-4, 2023年: 推論とマルチモーダル理解をさらに押し進めた。

製品の転換点は ChatGPT でした。専門家でない人にも言語モデルへの直接のインターフェースを与え、技術を「読める」ものにしたのです。

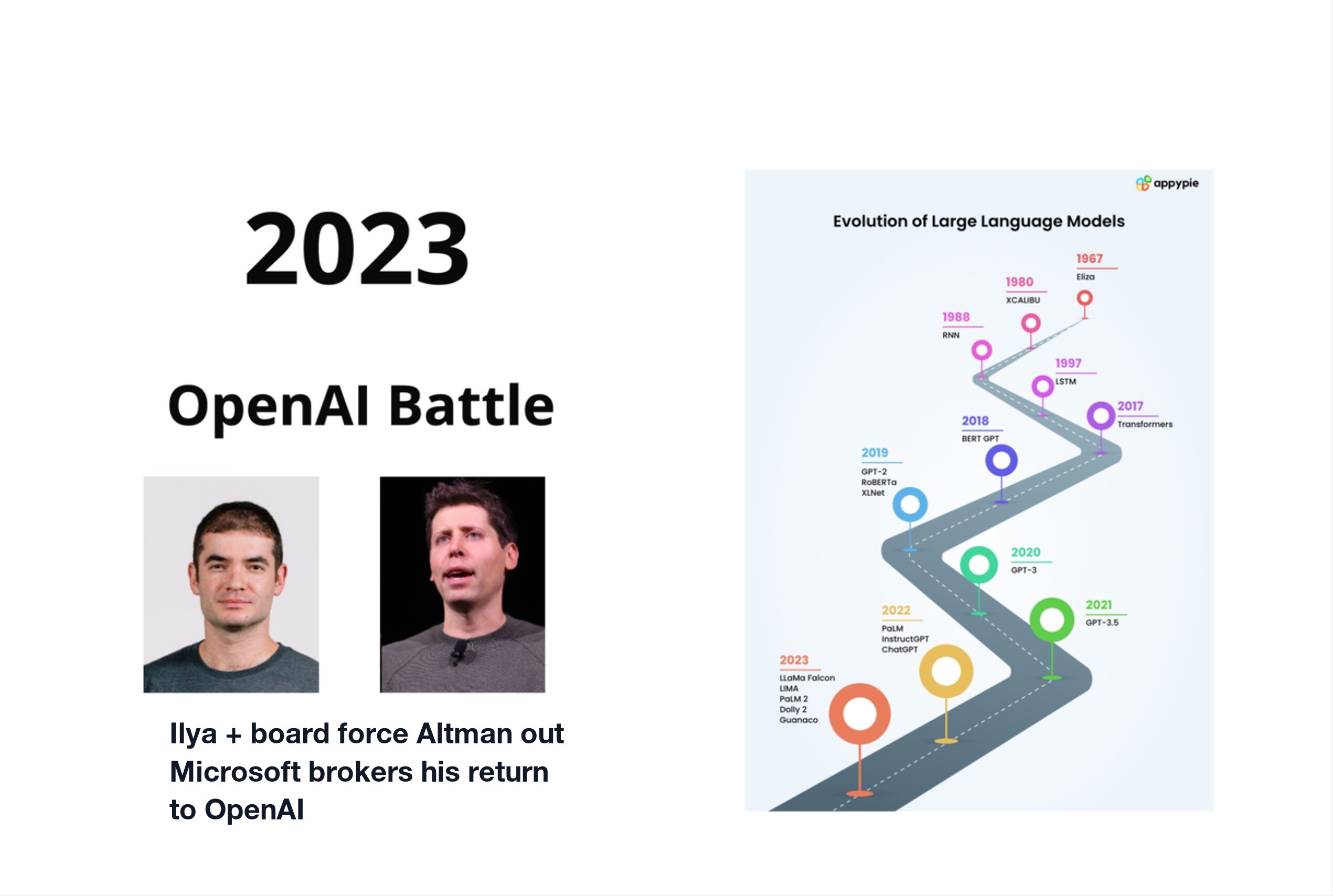

1.7 2023年: 統治が本筋に登場する

2023年11月、OpenAI は公の場でガバナンス危機に見舞われました。

5日間にわたるドラマは異例なほど公開で進みました。Sam Altman が CEO を解任され、社員が抗議し、Microsoft が緊急の受け皿となり、Altman が復帰し、取締役会の構成も変わりました。

ここでの細かい経緯は、本書にとっては教訓ほど重要ではありません。

フロンティアの AI は、技術の問題であるだけでなく、組織(institution)の問題でもある。

モデルには組織が必要です。組織にはインセンティブ、取締役会、投資家、社員、安全性への懸念、製品のプレッシャー、そして社会的な責任があります。

モデルが十分に重要になった瞬間から、アーキテクチャと統治は別々のトピックではなくなります。

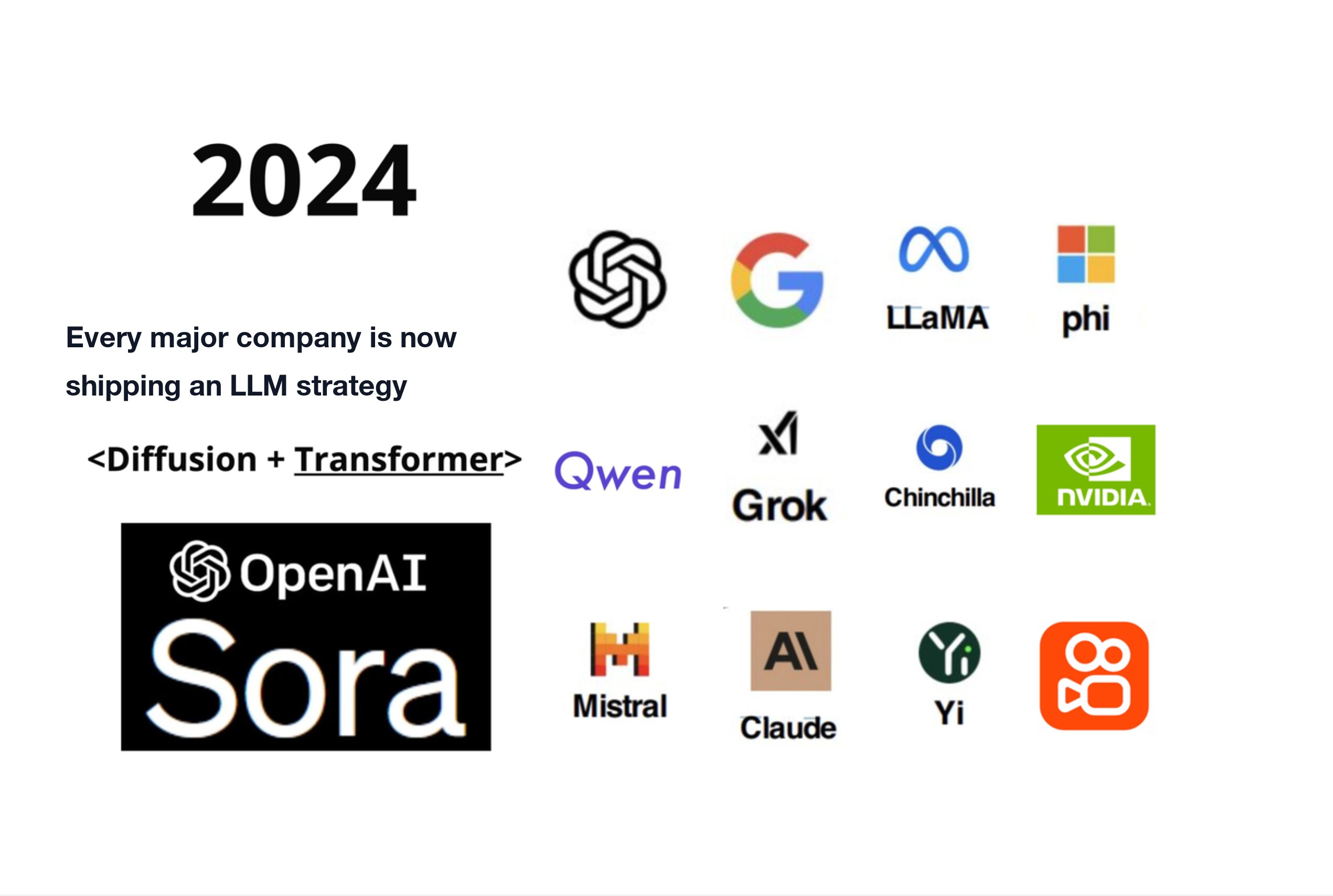

1.8 2024年: 広がる AI ランドスケープ

2023年の製品的なショックのあと、分野は一気に広がりました。

重要なトレンドには次のようなものがあります。

- OpenAI が GPT-4 級のモデルと動画生成を推し進める。

- Google が Gemini を進化させる。

- Meta が LLaMA 系のオープンモデルをエコシステムの中心に据える。

- Anthropic が Claude で競争に加わる。

- Mistral がヨーロッパの重要モデルラボとして頭角を現す。

- アリババの Qwen をはじめとする中国系モデル群が急速に成長する。

- Microsoft の phi シリーズ(小型モデル)が、効率的なローカル運用の可能性を広げる。

- 小型モデルが、ローカルや特化用途で実用的になる。

最初はテキストのモデルパターンとして始まったアーキテクチャが、マルチモーダル、ツール利用、エージェント、コード、動画にまで広がっていきました。

2024年のパターンとしてひとつ名前を挙げておきたいのが、Diffusion + Transformer です。Sora がこの方向性を可視化しました。製品の細かい仕様より、アーキテクチャ上の教訓が大事です。Transformer 流の系列モデリングは、もはや言葉だけのものではなく、動画・画像・行動・時間をモデルが整理するための一部になりつつあるということです。

1.9 2025年: チャットから「行動」へ

2025年になると、方向ははっきりしてきました。モデルは「質問に答える」ものから「行動する」ものへと動き始めたのです。

1.9.1 エージェント

エージェントはツールを使い、ファイルを読み、コマンドを走らせ、コードを書き換え、複数のステップにまたがって作業を続けます。重要な変化は自律性です。モデルはもうテキストを生成しているだけでなく、ワークフローの内側で動いているのです。

1.9.2 ディープリサーチ

リサーチ系のシステムは、複数のソースを横断して検索・読解・比較・統合・引用を行います。これは長文脈の言語モデリングとツール利用を組み合わせた、自然な拡張です。

1.9.3 世界モデル

世界モデルは、物理世界が時間とともにどう変わるかを理解しようとするものです。これは言語の枠を超え、状態、因果、身体性のある推論へと踏み込んでいきます。

Fei-Fei Li の空間知能(spatial intelligence)に関する仕事は、まさにこの方向を指しています。テキストのパターンだけでなく、シーン、物体、物理的な関係そのものを理解するモデルです。

1.9.4 ロボティクス

ロボティクスは、視覚、計画、制御、そして物理的制約を組み合わせます。予測を行動につなげられるかを AI に問う、もっとも難しいテストのひとつです。

Yann LeCun の JEPA 系の研究は、別の角度から関連した主張をしています。予測は、次トークンのテキストとしてではなく、有用な表現空間で行われるべきだ、というものです。

1.10 章のまとめ

1.10.1 主要なタイムライン

| 年 | 出来事 | なぜ重要か |

|---|---|---|

| 2015年 | AlphaGo と OpenAI | 深層学習が戦略的なものに |

| 2017年 | 「Attention Is All You Need」 | Transformer の登場 |

| 2018年 | GPT-1 | Transformer が生成モデルになる |

| 2020年 | GPT-3 | スケールが驚くべき能力を示す |

| 2022年 | ChatGPT | LLM が公共生活に入る |

| 2023年 | GPT-4 と統治危機 | 能力と組織の両方が問われる |

| 2024年 | マルチモーダルとオープンモデル | エコシステムが広がる |

| 2025年 | エージェントとリサーチ系 | チャットから行動へ |

1.10.2 2つの中核アイデア

-

Transformer が土台である。 GPT、BERT、LLaMA、Gemini、Claude をはじめ、多くのシステムが Transformer 的な発想の上に立っています。Transformer を理解することは、現代 AI の文法を手に入れることだと、私はこう覚えています。

-

スケールは振る舞いを変える。 小さな言語モデルから大きなものへの飛躍は、「同じものが多くなった」だけではありません。GPT-1 はおよそ 1 億パラメータ、GPT-4 は 1 兆超と推定されます。実に 1 万倍です。大きなモデルは、小さなモデルでは現れない質的に異なる振る舞い ― 創発的な能力を見せます。力技(brute force)が効いてしまった。これは居心地の悪い事実ですが、事実です。

章末チェックリスト

この章を終えたあとは、次のことができるはずです。

- GPT がどこから来たかを 3 分くらいで説明できる。

- 以前の系列モデルと比べて、なぜ Transformer が重要だったかを説明できる。

- OpenAI、Google、Meta、オープンソースエコシステムが、それぞれどんな役割を果たしてきたかを言える。

- AI 研究所が技術と組織の両方のシステムである理由を説明できる。

次の章でお会いしましょう

歴史はいったんここまでで十分です。タイムラインを見返さなくても、2015年からエージェント時代までの GPT の物語を語れるなら、頭の中に正しい地図ができています。

次の章では、モデルそのものの謎を解いていきます。

Andrej Karpathy には有名なフレーミングがあります。「大規模言語モデルは2つのファイルにすぎない」。一見、単純すぎるように聞こえますが、LLM が本当のところ何なのかを理解するうえで、これはとても強力な切り口です。

ここまでで本章はおしまいです。次の章では、その「2つのファイル」を入り口にして、LLM の中身を分解していきます。